با وجود تمام پیچیدگیهایی که برای پیادهسازی فناوری تشخیص چهره وجود دارد، بسیاری از محصولات چینی از این فناوری بهره میبرند. در کشور چین بیش از ۲۰۰ میلیون دوربین نظارت تصویری نصب شده که طبق آمار تعداد این دوربینهای نظارتی در حدود بیش از چهار برابر تعداد دوربینهای نظارت تصویری ایالات متحده آمریکا است.

علاوهبر این تعداد دوربین نظارتی، کشور چین از سیستمهای تشخیص چهره نیز برای شناسایی و ردیابی اقلیت مسلمان اویغور استفاده میکند و با فناوریهای تشخیص چهره، مسلمانان اویغوز را در ورودی مجتمعهای مسی شناسایی میکند.

مقالههای مرتبط:

در صنعت حفاظت، علاوهبر چین در سایر کشورهای نیز استفاده از چنین فناوریهایی بهوفور دیده میشود. مثلا فناوریهای تشخیص هویت به شکل دیگری در آمریکا مورد استفاده قرار میگیرد. اما قبل استفاده از این فناوریها، این سوال مطرح میشود که آیا منافع عمومی و منافع خصوصی شهروندان در استفاده از چنین فناوریهایی مورد توجه قرار میگیرد؟ اخیرا گروهی از متخصصین هوش مصنوعی وابسته به دانشگاه نیویورک که در شرکتهای فناوری بزرگی از جمله گوگل و مایکروسافت هم مشغول فعالیت هستند، مقالهی جدیدی در مورد این موضوع منتشر کردهاند. این گروه متخصص، از دولتها درخواست کردهاند تا قوانین مشخصی برای سیستمهای مبتنی بر هوش مصنوعی و فناوری تشخیص چهره تدوین کنند تا آزادیهای مدنی شهروندان تضعیف نشود. نویسندگان در مقالهی خود اعلام کردند:

تشخیص چهره و تشخیص احساسات، نیازمند تنظیم مقررات قدرتمندی هستنند تا منافع عمومی و فردی شهروندان نادیده گرفته نشود. این مقررات باید در حوزهی قوانین ملی تدوین شود تا تحت نظارت قدرتمند دولت بتواند قابلیت اجراییشدن داشته باشد و برای عموم مردم نیز شفاف و روشن باشد. شهروندان باید به انتخاب خودشان، حق استفاده یا عدم استفاده از چنین فناوریهایی را در هر دو حالت عمومی و خصوصی در اختیار داشته باشند. تنها، صرف اطلاعرسانی عمومی در مورد استفاده از چنین فناوریهایی کافی نیست و با توجه به خطرات ناشی از چنین سیستمهای نظارتی، باید کاربران در مورد استفاده از این فناوریها رضایت کامل داشته باشند.

در حال حاضر، محققان هوش مصنوعی، بهصورت خاص نگران «affect recognition» یا تشخیص احساسات هستند. این سیستمها با استفاده از یادگیری ماشین، میتوانند احساسات کاربر را پایش کرده و تشخیص دهند. مرید ویتاکر، همبنیانگذار AI Now که در گوگل نیز مشغول فعالیت است، در گفتگو با بلومبرگ گفت: «هیچکس جوابگوی استفاده از چنین فناوریهایی نیست و ما قصد داریم برای مسایل مربوط به این حوزه، کاری انجام دهیم.» براد اسمیت، ریاست مایکروسافت، در سخنرانی که در موسسه بروکینگز ارائه کرد، به برخی از این موارد اشاره نمود:

به اعتقاد ما، دولتها باید در سال ۲۰۱۹ میلادی، قوانین مشخصی برای استفاده از چنین فناوریهای مهمی تدوین کنند. حدود پنج سال است فناوری تشخیص چهره بهصورتی گسترده مورد استفاده قرار میگیرد و باعث تشدید مسایل اجتماعی شده است. تا زمانی که وضعیت استفاده از این فناوری در چارچوب قانونی مشخصی معلوم نشود، مشکلاتی که این فناوری بههمراه خواهد داشت، ادامه پیدا میکند و پایان نخواهد یافت.

وی در ادامهی صحبتهای خود اشاره کرد:

بهطور خاص، زمانی که شرکتهای فناوری مجبور هستند بین مسئولیتهای اجتماعی و موفقیت خودشان در بازار یکی را انتخاب کنند، اعتقاد نداریم که این موضوع به رقابت تجاری آنها لطمه وارد میکند. معتقدیم که تنها راه درست، ایجاد فضایی مسئولانه است که در آن رقابت سالمی نیز در بازار وجود داشته باشد. درنتیجه باید مطمئن شویم که فناوریهای جدید و شرکتهایی که به توسعهی این فناوریها مشغول هستند، تحت قوانین مشخصی به حرکت خود ادامه میدهند.

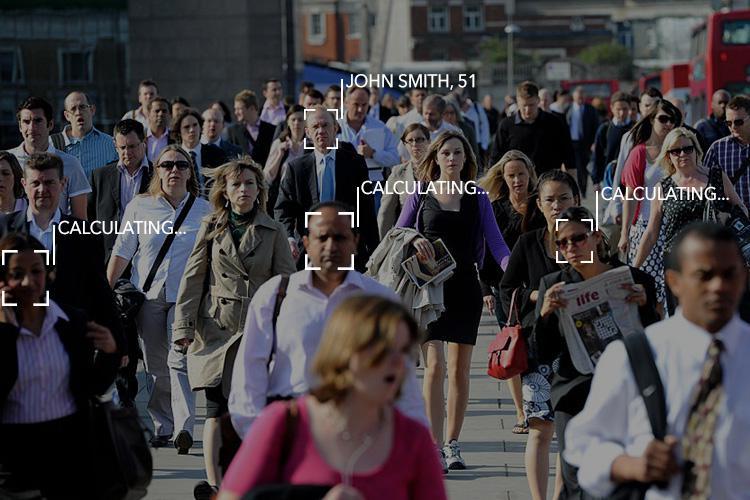

این مقاله یک روز پس از انتشار خبر آزمایش فناوری تشخیص چهره برای حفاظت از کاخ سفید منتشر شد. ACLU معتقد است که آزمایش فناوری تشخیص چهره بهصورت محدود انجام شده است ولی میتواند تبعات گستردهای داشته باشد. در این برنامهی نظارتی، شهروندان آمریکایی حتی در پیادهروهای عمومی و خارج از کاخ سفید و مسیری منتهی به کاخ سفید، توسط فناوری تشخیص چهره از فاصلهی ۱۸.۲ متری (۲۰ یارد) با دوربینهای نظارتی شناسایی میشوند. از آنجایی که عموما استفاده از چنین سیستمهای فناوری تشخیص چهره بدون اطلاع و اجازهی شهروندان مورد استفاده قرار میگیرد، این فناوریهای یکی از خطرناکترین فناوریهای تشخیص هویت بیومتریک از نظر نقض قوانین حریم خصوصی محسوب میشوند.

درباره این سایت